Hue Hoang

Thành viên nổi tiếng

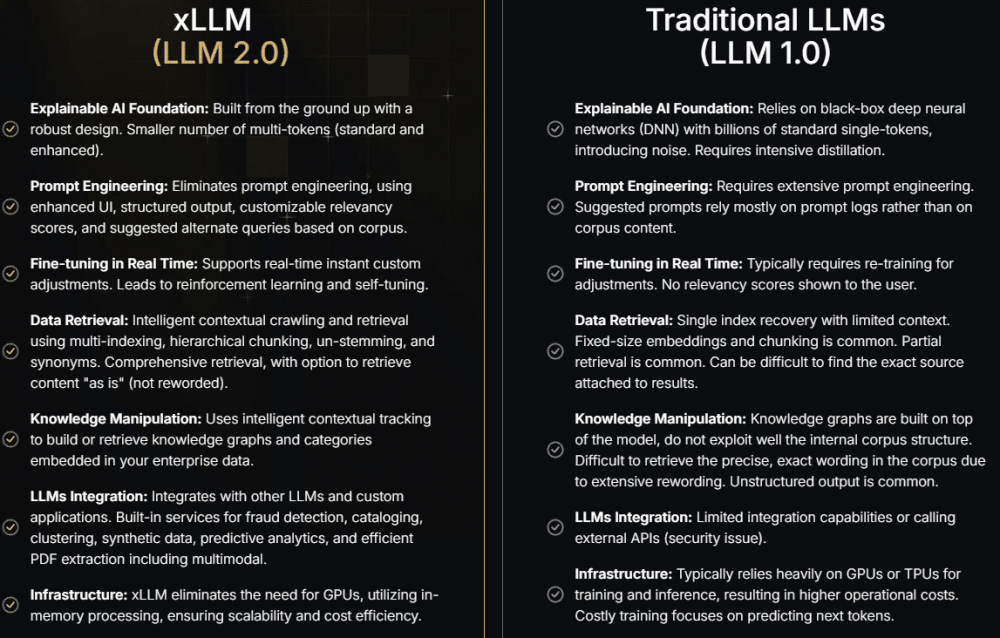

- Các mô hình LLM truyền thống (như ChatGPT) xuất hiện từ khoảng năm 2022, sử dụng kiến trúc transformer với mạng nơ-ron sâu (DNN), đòi hỏi chi phí đào tạo cao và phụ thuộc vào GPU. - LLM truyền thống đối mặt với nhiều vấn đề về hiệu suất: cần GPU và dữ liệu lớn, tái đào tạo tốn kém, vẫn xảy ra ảo giác, tinh chỉnh phức tạp và cần kỹ thuật prompt engineering. - Chi phí là vấn đề lớn: ngoài chi phí GPU, mô hình tính phí theo token khuyến khích nhà cung cấp sử...

- Các mô hình LLM truyền thống (như ChatGPT) xuất hiện từ khoảng năm 2022, sử dụng kiến trúc transformer với mạng nơ-ron sâu (DNN), đòi hỏi chi phí đào tạo cao và phụ thuộc vào GPU. - LLM truyền thống đối mặt với nhiều vấn đề về hiệu suất: cần GPU và dữ liệu lớn, tái đào tạo tốn kém, vẫn xảy ra ảo giác, tinh chỉnh phức tạp và cần kỹ thuật prompt engineering. - Chi phí là vấn đề lớn: ngoài chi phí GPU, mô hình tính phí theo token khuyến khích nhà cung cấp sử...Đọc bài gốc tại đây